IT之家 8 月 27 日消息,科技媒体 Techcrunch 昨日(8 月 26 日)报道,Anthropic 公司公开了 Claude AI 模型的“系统提示词”(system prompts)。

系统提示词(System prompt)

为了让 AI 模型更好地理解人类指令,提示词(Prompt)工程实际上包含 2 层核心内容,用户提示词(User prompt)和系统提示词(System prompt):

用户提示词:用户输入的提示词,然后 AI 模型基于用户提示词生成答案。

系统提示词:这是由系统生成的提示,通常用于设定对话的背景、提供指导或规定规则。

IT之家注:通常情况下,系统提示词会让模型了解自己的基本素质,以及应该做什么、不应该做什么。

业内常规做法

从 OpenAI 到 Anthropic,每一家生成式人工智能厂商都会使用系统提示来防止(或至少试图防止)模型出现不良行为,并引导模型回复的总体语气和情绪。

例如,系统提示词可能会告诉模型,它应该礼貌但绝不能道歉,或者坦诚地承认它不可能知道所有事情。

但厂商可能是出于竞争等方面原因,以及避免不良用户在了解这些信息后绕过安全防护,通常保密这些系统提示词。

Anthropic 选择公开系统提示词

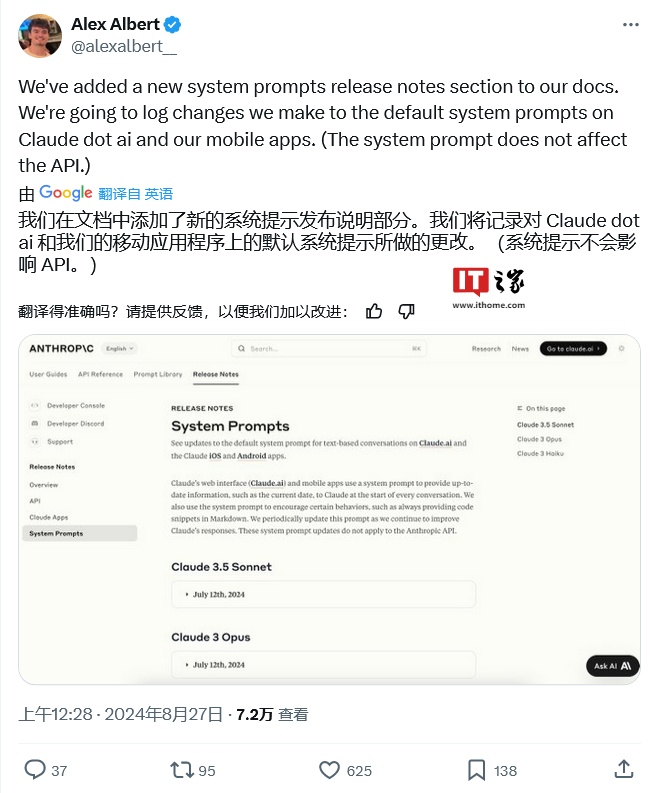

不过,Anthropic 一直在努力将自己描绘成一家更道德、更透明的人工智能供应商,它已在 Claude iOS 和 Android 应用程序以及网络上公布了其最新模型(Claude 3.5 Opus、Sonnet 和 Haiku)的系统提示。

Anthropic 开发者关系负责人亚历克斯・艾伯特(Alex Albert)在 X 上发表的一篇文章中说,Anthropic 计划在更新和微调系统提示的过程中,定期公布此类信息。

广告声明:文内含有的对外跳转链接(包括不限于超链接、二维码、口令等形式),用于传递更多信息,节省甄选时间,结果仅供参考,IT之家所有文章均包含本声明。